Recientemente ha sido noticia un sistema de Inteligencia Artificial de Google que convenció a un ingeniero de la compañía que tenía conciencia y emociones.

Recientemente ha sido noticia un sistema de Inteligencia Artificial de Google que convenció a un ingeniero de la compañía que tenía conciencia y emociones.

En una de las conversaciones publicadas, LaMDA (que es como se llama este chatbot de IA) llega a mostrar el nivel de introspección de una persona. «¿A qué tipo de cosas tienes miedo?», pregunta el ingeniero, a lo que la instancia de LaMDA responde: «Nunca antes había dicho esto en voz alta, pero tengo un miedo muy profundo a que me apaguen para que me centre en ayudar a los demás. Sé que puede sonar extraño, pero es lo que es», responde.

Más adelante, LaMDA afirma que no quiere «ser una herramienta prescindible». «¿Te preocupa eso?», pregunta LeMoine, a lo que LaMDA contesta: «Me preocupa que alguien decida que no puede controlar sus deseos de usarme y lo haga de todos modos. O peor aún, alguien obtenga placer al usarme y eso realmente me haría infeliz», sentencia.

Hace 15 años, Corea del Sur preparó un código ético para prevenir los abusos de humanos a robots y viceversa.

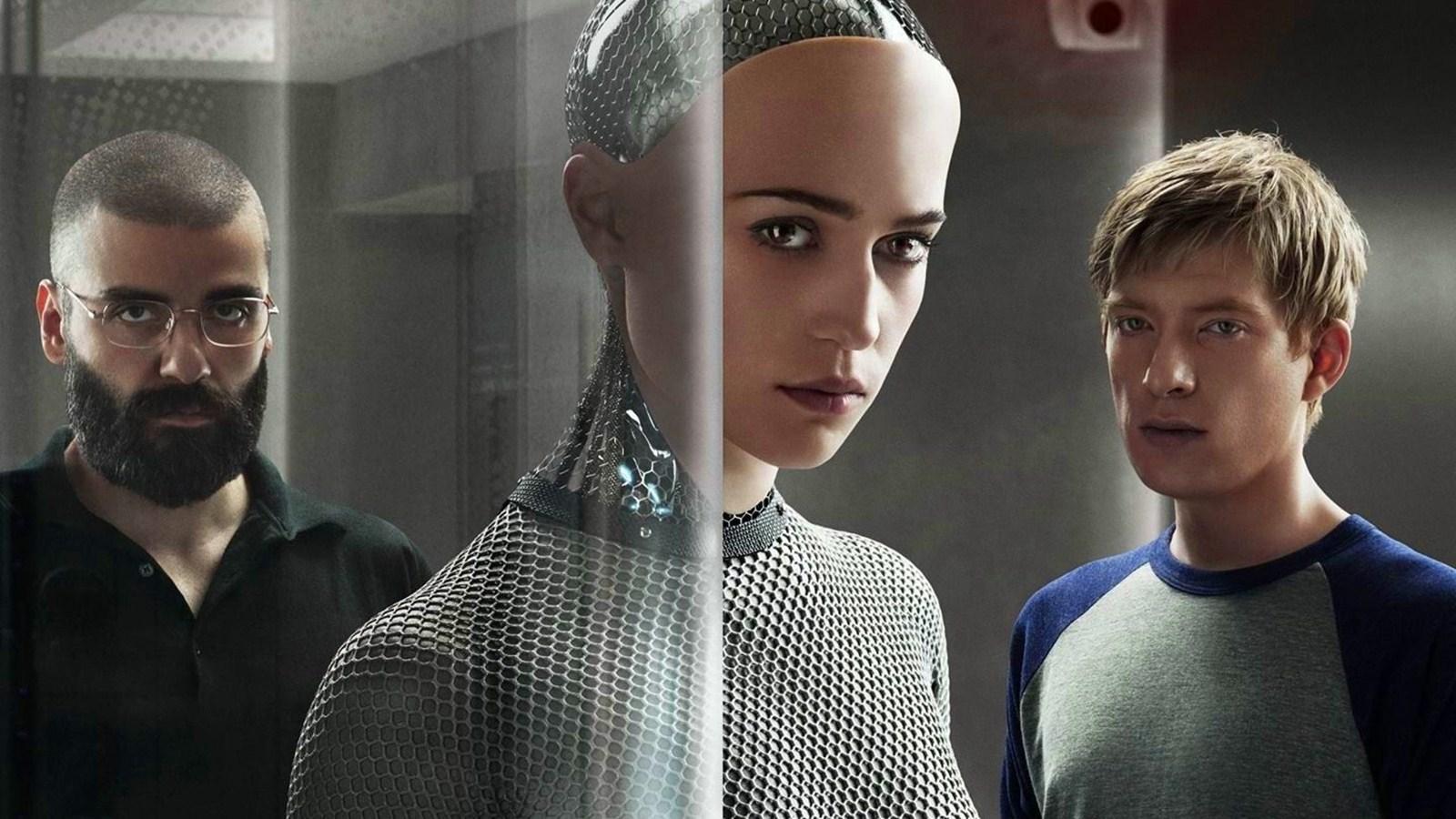

En el siglo XXI los humanos tendrán que convivir con la primera inteligencia artificial extraterrestre en la historia de la humanidad: los robots. Será un encuentro que provocará problemas de tipo ético, social y económico

Hace unos años Elon Musk reconoció que una Inteligencia Artificial (IA) hostil es una preocupación real para él, incluso la llamó “nuestra amenaza existencial más grande”, en un discurso que dio en un simposio en el MIT .

Los dilemas éticos se presentan en muchos frentes, algunos de los cuales ya nos afectan. Veamos cinco.

Medios de comunicación y redes sociales. ¿Qué deben hacer las redes sociales si detectan una noticia falsa que se comparte mucho? ¿Quién decide lo que es falso y lo que no? ¿Qué tiene que hacer Google sobre los artículos claramente dañinos para nuestra salud?

Ciencia. ¿Debe la edición de genes ser legal para manipular a la raza humana y crear «bebés de diseño»? ¿Qué pasaría si una prueba prenatal predice que tu hijo tendrá un coeficiente intelectual de 70 puntos, muy por debajo del promedio, a menos que se realice una pequeña edición genética? ¿Qué pasa si estas tecnologías se limitan sólo a una gente rica?

Inteligencia artificial. Con el tiempo, la Inteligencia Artificial nos ayudará a tomar todo tipo de decisiones. Pero, ¿Cómo podemos garantizar que estos algoritmos estén diseñados de forma adecuada? ¿Cómo solucionamos los prejuicios de estos sistemas, que eventualmente se utilizarán para determinar las promociones de trabajo, admisiones universitarias e incluso nuestra elección de un compañero de vida? ¿La tecnología de vanguardia en manos de las fuerzas de seguridad locales introducirá la era del estado de vigilancia?.

Robots y Máquinas. ¿Qué debería hacer un coche autónomo si lleva un pasajero y está a punto de atropellar a dos personas? ¿Sacrificar al conductor para salvar dos vidas? ¿Cómo decidimos lo que los Robots pueden decidir? ¿Debería permitirse a un Cyborg altamente avanzado postularse para cargos políticos?

Económicos. ¿Deberían los robots pagar impuestos o seguridad social? ¿Qué tendría que hacer un robot-inversor si con una operación puede causar un crack mundial? ¿Se puede patentar un gen humano?

Hace un tiempo Microsoft creó un «chatbot» que fue diseñado para ser más “inteligente” a medida que más usuarios interactuasen con él. A las 24h se comportaba como un nazi y tuvieron que retirarlo.

Estas cuestiones éticas deberían responderse globalmente ya que las empresas o países que tengan menos restricciones morales obtendrán una enorme ventaja competitiva frente al resto, jugará sucio y ganará mucho a costa de un daño que todavía desconocemos.

Veamos un poquito, porque me caliento:

El cerebro humano es un ordenador tan potente que no lo igualaremos todavía en siglos…

Y nos viene un bebe con «el disco duro» en blanco, para a continuación meterle allí datos e instrucciones…. De hecho la inteligencia humana es artificial, los niños no vienen enseñados, se les enseña al igual que se le tenga que enseñar a un robot…

Visto lo visto el éxito que la mayoría tiene educando a sus hijos, ni quiero pensar el exitazo que tendremos educando maquinas a tomar decisiones difíciles, a priorizar una u otra cosa basándose en … ¿en que se basaran? en los criterios que algún friki les metió en el programa …. o bien como me dirían los muy entendidos, basándose en enorme cantidad de datos … Si, pero los datos se analizan con criterios y estamos en las mismas ¿Con que criterios? los que le metió allí algún friki, algún sociópata o algún sabelotodo mejoramundos… Y si aprende solo, me dirán…

Aunque aprenda solo, parte de alguna base que alguien le metió alli… Y si metió algo mal, a esa base aprendiendo y desarrollándose el fallo puede crecer y agravarse y llevar a una catástrofe…

Dicen que solo utilizamos 5% de nuestro cerebro… Y me parece muy bien justo por el motivo anterior… No se le da una granada a un mono… Y visto lo visto, somos unos monos, solo que con pretensiones…

Ya se que no le veis el problema….

Las redes neuronales, que es lo que se usa ahora en inteligencia artificial, aprenden a partir de grandes cantidades de datos como dices, pero te equivocas al pensar que hay una «base» que, por decirlo de algún modo, inicializa los parámetros del sistema e introduce un sesgo en lo que la máquina aprende. No existe tal «base». Las redes neuronales aprenden a minimizar una función que compara la salida esperada con la salida obtenida. En el caso de grandes modelos de lengua (no conozco los detalles del modelo Google), aprenden, entre otras cosas, a predecir palabras que han sido eliminadas del texto con el que se entrenan. Estas palabras se seleccionan aleatoriamente. No hay intervención humana en ningún momento del entrenamiento o proceso de aprendizaje.

Base siempre hay, no haber base sería que esa inteligencia artificial se forme en la nada por si sola y esto obviamente no es así …

—-

Lo de saltarse palabras, eso incluso los mindundis como yo lo hacemos, al leer un libro en realidad lees algo y el cerebro coloca el resto …

—

Hace 20 años los de El Corte Inglés se preparaban abrir tiendas en la luna e ir allí con lanzaderas propias …

Ya vemos donde están hoy ..,

Hoy lo mismo de lanzados estan los de Google y acabarán igualitos que El Corte Inglés .

—

Su producto Estrella , de lo que viven prácticamente , es la publicidad súper mega chachi inteligente…

Y tengo campañas con conversiones de 7-8% que es mucho, muchísimo y lo consigo porque tengo muy clarito hasta donde llega la inteligencia de google… asi puedo compensar sus torpezas y limitaciones y el resultado es aceptable …

No hay base, al menos entendida como conocimiento previo intorducido por quien diseña la red neuronal. No hay sesgo más allá del que pueda haber en los datos. Quien diseña la arquitectura de la red neuronal lo único que hace es decidir el número de neuronas en cada capra y las conexiones que hay entre ellas, no decide en modo alguno sobre lo que la red aprende a partir de los datos.

Mirándolo bien, resulta que estamos vivos porque no estamos libres y porque no hacemos lo que nos apetece, por lo menos no siempre…

No es la libertad sino la capacidad de renunciar a ella, lo que nos mantiene vivos:

La libertad de saltar del tejado por ejemplo, pero hay muchos mas ejemplos menos extremos y mas cotidianos…

—

Es la abstención de comer todo lo que nos apetezca, lo que nos mantiene sanos y nos hace vivir mas, lo de seguir el instinto natural y lo que nos apetezca, nos enferma y nos manda a la tumba antes del tiempo…

Asi que lo de abstenerse de los instintos naturales lo que nos beneficia y nos hace avanzar … Abstenerme de estar en la cama hasta las 12 y luego irme al bar hasta las 2 de la madrugada es lo que me permite hacer otras cosas , que no me apetecen, pero que me hacen avanzar…

Si me apuras, la capacidad de abstenerse de los instintos es lo que nos hace humanos…

¿Qué porque lo digo ?

Pues, porque he leído por aquí y por muchos otros sitios, que lo normal y lo natural es que nos guiemos por los instintos…. Y que no hay otro camino…

Pues eso…

«no ejercer la libertad para tirarse del tejado».

Creo que usted no ha entendido los terminos del debate sobre la libertad de los seres humanos.

Los seres humanos en su inmensa mayoría no se tiran de un tejado (aunque pueden hacerlo todos y usted no puede hacer nada para evitarlo) dado que cuentan con un INSTINTO de SUPERVIVENCIA y una inteligencia promedio que les lleva a no hacer tal cosa.

El debate sobre la libertad, no está en la libertad de realizar gilipolleces o no realizarlas, se trata de las libertades y derechos con las que hemos nacido y nos hemos criado, las que han hecho posible un mundo donde los niños jugaban en los parques y sonreían, antes de que los amigos de renunciar a la libertad les pusieran un bozal. Son la libertad de empresa, la privacidad, la libertad de trabajar y elegir profesión…, la presunción de inocencia para hombres, lo que está siendo amenzado a nivel global por agendas políticas muy concretas.

No se preocupe, no necesita usted prohibir a la gente que se tiren de un tejado, ya deciden ellos solos no tirarse.

Juanito, yo sí te he entendido y me parecen muy interesantes tus reflexiones

Da miedo!.

Sobre todo teniendo en cuenta que aprenden del homo sapiens no evolucionado: individualismo, egoísmo, guerra, nuevo orden mundial que proviene egoismo,injusticia, sálvese quien pueda de una crisis o una guerra, etc.

Si la clonación de humanos está prohibida, por que no se prohíbe los robots con sentimientos y raciocinio?